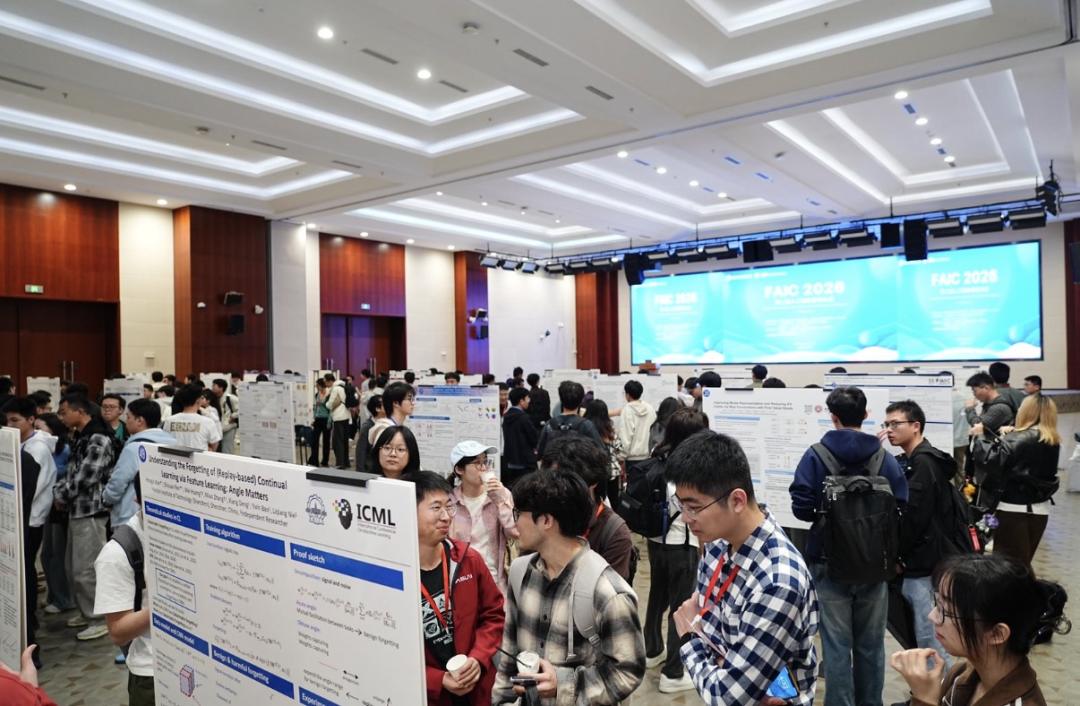

当大模型的性能竞赛持续加速,人工智能研究正步入“深水区”:模型为何有效?能力如何形成?训练怎样更高效、更稳健?4月18日至19日,2026 FAIC第二届人工智能基础大会在上海财经大学举行。来自清华大学、北京大学、香港中文大学、香港中文大学(深圳)、中国人民大学、上海交通大学、浙江大学、南京大学、上海财经大学、华为等顶尖高校与企业的400余位学者与行业专家齐聚一堂,围绕大语言模型、AI for Math、机器学习理论等核心领域展开了深入研讨。

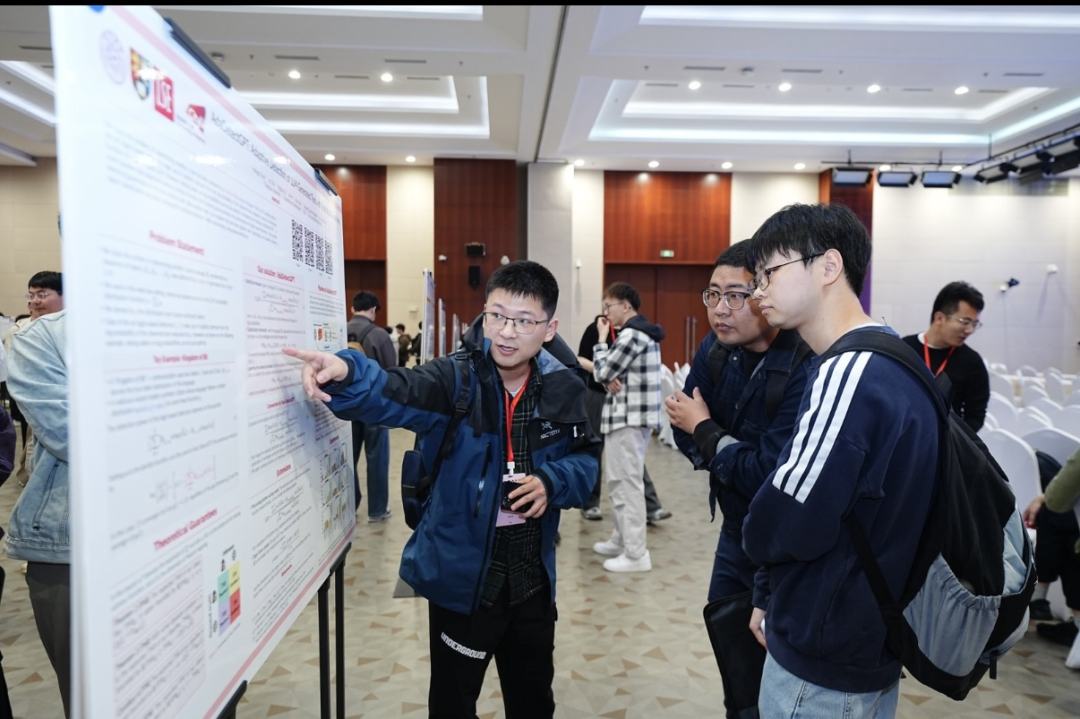

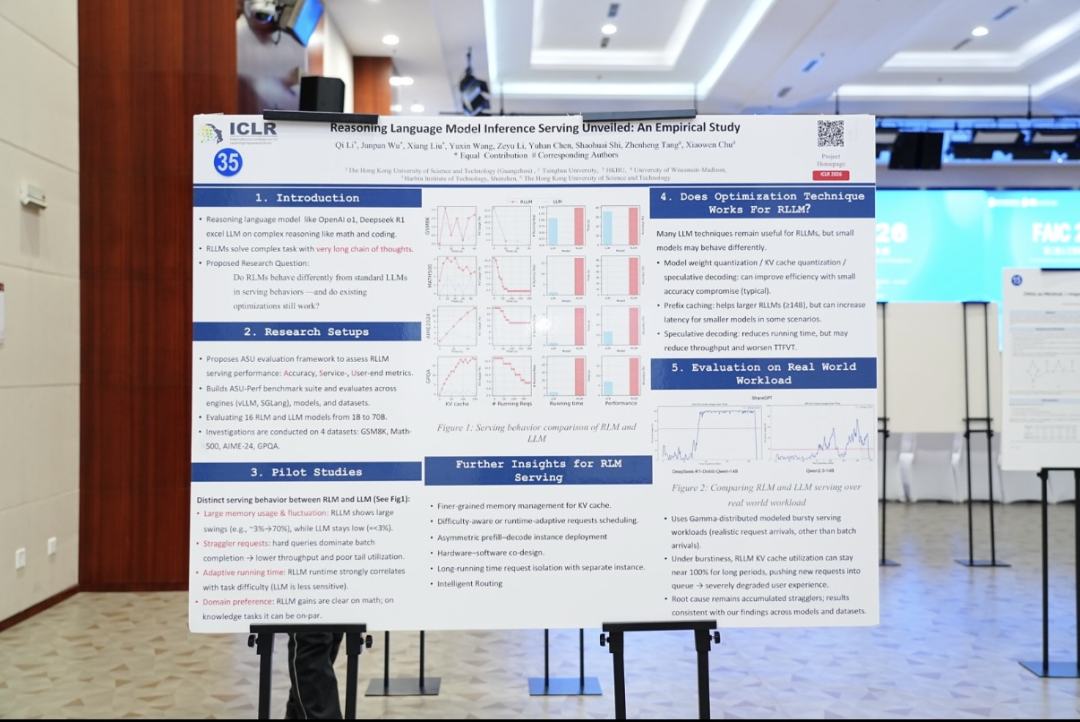

本届大会由FAIC人工智能基础大会组委会主办,起源于已成功举办三年的人工智能基础线上研讨班(FAI-Seminar)。过去三年中,该研讨班举办了80场线上学术讲座,累计吸引超过38万人次观看,汇聚了一大批国内外关注AI基础研究的专家学者。大会设置主旨报告、平行论坛、海报展示等环节,旨在搭建高水平的学术与应用交流平台,共同探讨人工智能基础研究的发展趋势与创新路径。

主旨报告环节,多位知名学者分别从模型结构、数学智能化、大模型机理等角度展开演讲,内容既有对基础理论的深入探讨,也有对未来技术路线的前瞻判断。与会专家普遍认为,人工智能研究正逐步从经验驱动走向理论探索与方法创新并重的阶段,本次大会恰好捕捉到了这一关键转变。

平行论坛的议题涵盖了大模型基础理论、机器学习理论、随机算法的泛化理论、最优化理论、图机器学习、统计计算与模型加速、大模型训练与数据优化等多个方向。与会者既关注大模型如何训练得更高效、更稳定,也关注模型行为背后的内在规律,以及人工智能与科学研究、复杂场景应用深度结合的可能性。多场讨论传递出一个共识:面对模型规模扩大、训练成本上升和应用需求提升等现实挑战,单靠某一类方法已经不够,需要在基础理论、方法创新和系统优化等多个层面同时寻找突破。

会场内外的互动十分活跃。主旨报告后的提问直接而具体,讨论延续到走廊和海报展示区,不同研究方向之间的碰撞产生了许多有意义的交叉视角。在自由讨论环节,学者们没有停留在技术细节上,而是就基础研究如何支撑实际发展、模型能力与训练效率如何统筹、应用需求如何反馈到基础研究等议题进行了对话。

FAIC 2026的召开,恰逢人工智能研究更加重视基础、重视规律、重视长期积累的关键节点。无论是模型结构设计、训练方法改进,还是数据质量提升与交叉应用拓展,最终都要回到扎实的基础研究上。本次大会没有给出惊人的结论,但它传递了一个明确的信号:面对AI技术的快速演进,学术界与产业界需要坐下来,把那些绕不开的基础问题一步步解决掉。